L’article de Jiannan Xu, Gujie Li & Jane Yi Jiang, AI Self-preferencing in Algorithmic Hiring: Empirical Evidence and Insights, 9 février 2026 (https://arxiv.org/abs/2509.00462), examine un risque précis lié à l’usage de l’IA dans le recrutement : lorsqu’un modèle de langage est utilisé à la fois par les candidats pour rédiger ou améliorer leur CV et par l’employeur pour les évaluer, ce modèle tend-il à favoriser les textes qui lui ressemblent, notamment ceux qu’il a lui-même produits ?

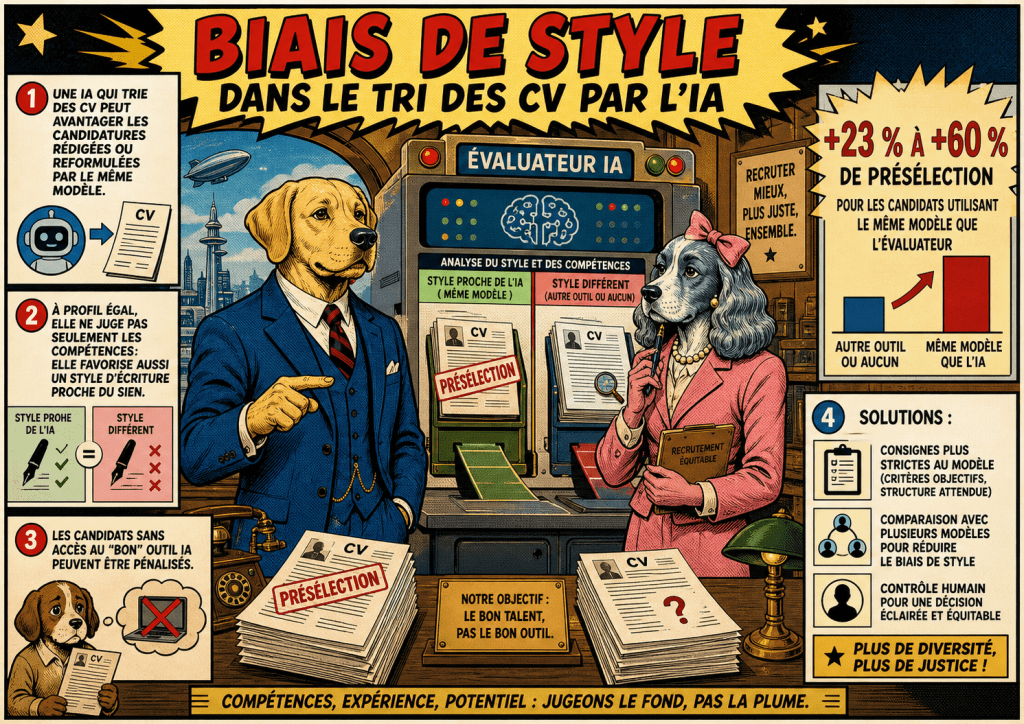

Les auteurs appellent ce phénomène « self-preferencing », que l’on peut traduire par biais d’auto-préférence. L’idée centrale est que le système d’évaluation ne se contente pas de juger les compétences du candidat ; il peut être influencé par la forme du texte, c’est-à-dire par un style rédactionnel proche de ses propres productions. Ce biais est distinct des biais classiques liés au sexe, à l’âge, à l’origine ou à d’autres caractéristiques protégées. Il naît de l’interaction entre deux usages de l’IA dans un même processus : l’IA qui rédige et l’IA qui juge.

Le contexte retenu est celui du tri de CV. Les auteurs partent d’un constat opérationnel important pour les RH : les candidats utilisent de plus en plus des outils d’IA pour reformuler leur dossier, tandis que les employeurs utilisent également des outils d’IA pour filtrer ou classer les candidatures. Le risque est donc que deux candidats comparables ne soient pas traités de la même manière, non parce que l’un serait plus qualifié que l’autre, mais parce que son CV a été rédigé ou reformulé avec le « bon » modèle, soit celui que l’employeur utilise ensuite pour l’évaluation. Dans cette hypothèse, le système récompense l’accès à un outil déterminé plutôt que la qualité réelle du profil. Pour un service RH, l’enjeu est donc à la fois juridique, éthique et organisationnel : l’automatisation peut améliorer l’efficacité du tri, mais elle peut aussi introduire une distorsion peu visible dans l’accès à l’entretien.

La méthode est construite de manière contrôlée. Les auteurs utilisent 2’245 CV réels, rédigés par des humains avant la généralisation des grands modèles de langage. Ils ne modifient pas l’ensemble du CV : ils se concentrent sur le résumé professionnel, soit la partie la plus rédactionnelle et la plus susceptible d’être retravaillée par une IA. Pour chaque CV, ils conservent les mêmes expériences, compétences et formations, puis demandent à plusieurs modèles de produire une version alternative du résumé. Les modèles testés comprennent notamment GPT-4o, GPT-4o-mini, GPT-4-turbo, LLaMA, Mistral, Qwen et DeepSeek. Ensuite, ces résumés sont présentés à des modèles évaluateurs, qui doivent choisir le meilleur résumé entre deux versions décrivant le même candidat. Le raisonnement expérimental est donc le suivant : si les qualifications sont identiques, une préférence systématique pour la version produite par le modèle évaluateur ne peut pas être expliquée par le profil du candidat ; elle révèle un biais lié à la source ou au style du texte.

Les auteurs distinguent deux situations. La première oppose un résumé rédigé par un humain à un résumé généré par le même modèle que celui utilisé pour l’évaluation. C’est le cas le plus important pour les RH, car il compare directement les candidats qui utilisent l’IA et ceux qui ne l’utilisent pas. La seconde oppose deux textes générés par deux modèles différents. Elle permet de vérifier si un modèle favorise uniquement l’IA en général ou, plus précisément, ses propres productions. Pour mesurer le biais, les auteurs utilisent deux approches inspirées des critères de justice algorithmique. La première compare simplement les taux de sélection : le modèle choisit-il plus souvent son propre texte ? La seconde cherche à neutraliser l’explication par la qualité rédactionnelle : même lorsque les textes sont de qualité comparable, le modèle choisit-il encore sa propre version ? Pour cela, les auteurs utilisent des contrôles statistiques portant sur la longueur, la clarté, la structure, la similarité sémantique et d’autres caractéristiques linguistiques, puis complètent l’analyse par des évaluations humaines indépendantes.

Les résultats sont nets pour la comparaison entre textes humains et textes générés par le modèle évaluateur. La plupart des modèles préfèrent fortement leurs propres productions à des résumés humains équivalents. Après contrôle de la qualité du contenu, le biais reste élevé pour les grands modèles : il se situe entre 67 % et 82 % pour plusieurs modèles commerciaux ou open source majeurs. GPT-4o atteint notamment un niveau supérieur à 80 %. Cela signifie que le phénomène ne s’explique pas seulement par le fait que les textes générés seraient plus fluides ou mieux structurés. Même lorsque la qualité rédactionnelle est neutralisée, le modèle conserve une tendance propre à privilégier le texte qui lui ressemble. Les annotations humaines renforcent cette conclusion : dans certains cas, le modèle choisit son propre résumé alors que les évaluateurs humains considèrent la version humaine comme meilleure.

Les résultats sont plus nuancés lorsque les modèles comparent leurs propres textes à ceux d’autres modèles. Le biais existe, mais il varie davantage selon les modèles et les paires comparées. DeepSeek-V3 manifeste une auto-préférence plus marquée que les autres dans ces comparaisons entre IA. GPT-4o et LLaMA montrent des comportements moins systématiques, parfois même une préférence pour le texte d’un autre modèle. Cette différence est importante : le biais n’est pas seulement une préférence générale pour un texte « rédigé par IA » ; il dépend aussi de la capacité du modèle à reconnaître, implicitement, des formes d’expression proches des siennes. Les auteurs parlent ici de « self-recognition », soit une forme de reconnaissance de ses propres productions.

Pour évaluer l’impact pratique, les auteurs simulent ensuite des processus de présélection dans 24 familles professionnelles. Le dispositif est parlant : pour un même profil, ils comparent une version humaine du résumé et une version produite par le modèle évaluateur, puis demandent au modèle de sélectionner des candidats pour des entretiens. En l’absence de biais, les deux versions devraient être retenues dans des proportions similaires. Or les candidats qui utilisent le même modèle que celui de l’employeur sont 23 % à 60 % plus susceptibles d’être présélectionnés que des candidats équivalents présentant un résumé humain. L’effet est particulièrement marqué dans des fonctions liées aux affaires, comme la vente, la comptabilité ou la finance, et plus faible dans des domaines comme l’agriculture, les arts ou l’automobile. Pour les RH, cela signifie qu’un outil de tri peut modifier l’allocation des entretiens avant même toute intervention humaine significative.

L’article attire aussi l’attention sur un risque cumulatif. Si les entreprises utilisent durablement certains modèles dominants pour trier les candidatures, les candidats auront intérêt à adapter leur dossier au style attendu par ces modèles. Progressivement, les CV pourraient converger vers les formes linguistiques favorisées par ces outils. Les candidats qui n’ont pas accès aux mêmes modèles, qui ne savent pas les utiliser ou qui privilégient une rédaction plus personnelle pourraient être désavantagés. Ce mécanisme peut créer un effet de verrouillage : le style du modèle dominant devient la norme implicite de sélection. Le risque n’est donc pas seulement individuel ; il concerne la diversité des candidatures, la qualité du vivier et la robustesse du processus de recrutement.

Les auteurs proposent deux mesures de réduction du risque. La première consiste à modifier l’instruction donnée au modèle évaluateur, en lui demandant explicitement de ne pas tenir compte de l’origine humaine ou artificielle du texte et de se concentrer uniquement sur la substance. Cette méthode réduit le biais, mais ne le supprime pas toujours. La seconde consiste à ne pas confier la décision à un seul modèle, mais à utiliser un vote majoritaire entre plusieurs modèles, dont certains plus petits et moins sujets à l’auto-reconnaissance. Cette approche se révèle plus efficace : dans les tests, elle réduit souvent le biais de plus de 50 %. Pour GPT-4o, le biais passe par exemple de 82 % à 30 % ; pour LLaMA-3.3-70B, de 79 % à 23 %. L’intérêt pratique est que ces mesures ne nécessitent pas de réentraîner le modèle : elles relèvent de la conception du processus de sélection.

L’article ne dit pas que l’IA doit être exclue du recrutement. Il montre plutôt qu’un usage apparemment neutre peut créer une inégalité de traitement difficile à détecter. Pour des RH suisses, le message opérationnel est le suivant : lorsqu’un outil d’IA intervient dans le tri des candidatures, il faut auditer non seulement les biais classiques liés aux caractéristiques personnelles, mais aussi les biais nés de la chaîne technique elle-même. Il convient de documenter quel outil est utilisé, à quelle étape, avec quelles instructions, selon quelles métriques de contrôle, et avec quelle supervision humaine. La transparence envers les candidats, la traçabilité des décisions, la vérification périodique des écarts de sélection et la diversification des méthodes d’évaluation deviennent des garanties importantes. En termes juridiques, l’article invite à dépasser une vision étroite de la discrimination : le risque ne tient pas seulement à l’identité du candidat, mais aussi au fait que le système peut favoriser une modalité particulière de présentation du dossier sans rapport nécessaire avec l’aptitude au poste.

Me Philippe Ehrenström, avocat, LLM, CAS en Droit et Intelligence artificielle, CAS en Protection des données – Entreprise et administration