Est-ce que l’utilisation de l’IA, en elle-même, par ses effets induits sur les capacités cognitives du travailleur, est à même de porter atteinte à ses droits de la personnalité (art. 328 CO) ?

La question est assez peu couverte.

Voir déjà Upol Ehsan/Todd McNutt/ Samir Passi/ Mark O. Riedl/ Koustuv Saha/ Sara Alcorn, From Future of Work to Future of Workers: Addressing Asymptomatic AI Harms for Dignified Human-AI Interaction, arXiv:2601.21920v1 [cs.HC] 29 Jan 2026 ; résumé ici : https://droitdutravailensuisse.com/2026/02/01/promesses-de-lia-et-risques-invisibles-quand-les-gains-de-productivite-fragilisent-les-travailleurs/

Autre contribution : G.Liu/B.Christian/T.Dumbalsha/M.A. Bakkar/R.Dubey, AI Assistance Reduces Persistence and Hurts Indenpendence, Preprint, arXiv : 2604.047212v [cs.Ai], 7 avril 2026 (https://arxiv.org/pdf/2604.04721):

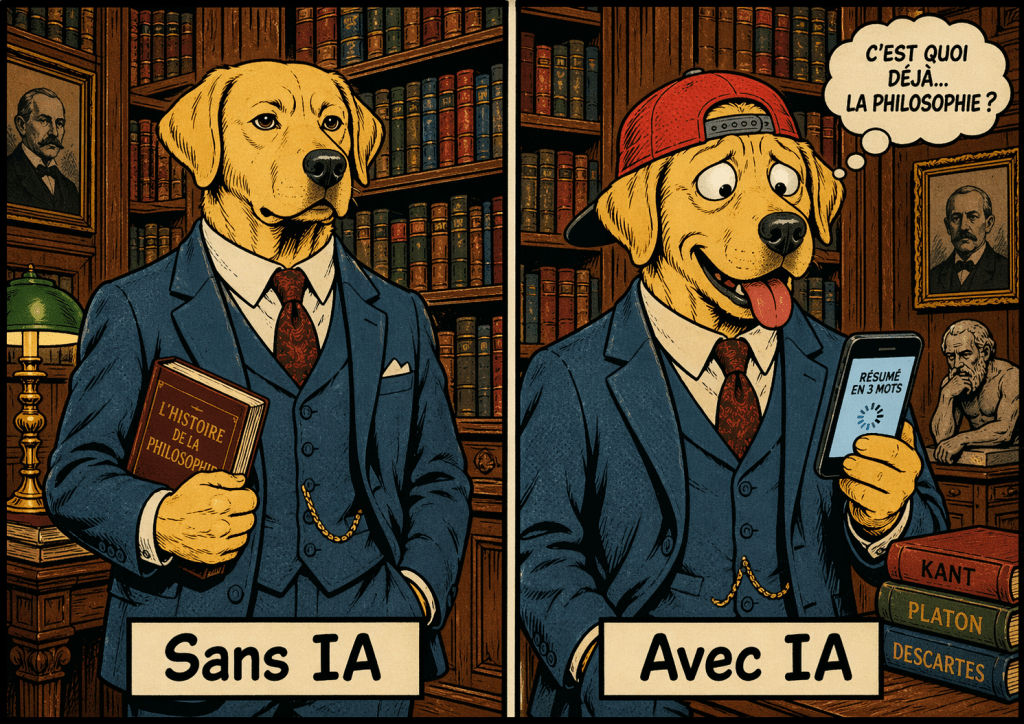

Cet article soutient la thèse que l’assistance par IA améliore souvent la performance immédiate, mais elle peut affaiblir, très vite, la capacité à travailler seul ensuite. Les auteurs ne s’intéressent pas seulement à l’exactitude des réponses; ils examinent aussi la persévérance, c’est-à-dire la tendance à continuer à chercher une solution plutôt qu’à abandonner. Leur idée de départ est que les bons collaborateurs humains n’aident pas seulement à obtenir un résultat sur-le-champ: ils dosent leur aide pour favoriser l’autonomie à long terme. Les assistants d’IA actuels, au contraire, sont conçus pour fournir des réponses rapides et complètes presque sans jamais refuser. Selon les auteurs, cette logique de service immédiat peut entrer en conflit avec l’objectif d’apprentissage et d’indépendance de l’utilisateur.

Pour tester cette hypothèse, l’équipe a conduit trois expériences randomisées sur 1’222 participants au total. Deux portent sur des exercices de fractions, la troisième sur la compréhension de textes. Le schéma est le même: un groupe travaille avec une aide IA de type GPT-5 pendant une courte phase d’apprentissage, l’autre sans cette aide; puis l’IA est retirée et tous doivent résoudre seuls de nouveaux problèmes. Les chercheurs mesurent alors deux choses: le taux de réussite et le taux de renoncement, c’est-à-dire la fréquence à laquelle les participants sautent la question plutôt que d’essayer d’y répondre. Cette méthode vise à isoler l’effet causal de l’assistance par IA sur la performance autonome, et non simplement à recueillir des impressions subjectives.

Le premier résultat est constant dans les trois expériences. Quand l’IA est disponible, les participants réussissent mieux sur le moment. Mais dès que l’IA disparaît, leur performance baisse davantage que celle du groupe témoin, qui n’avait jamais bénéficié de cette assistance. Dans la première expérience sur les fractions, les utilisateurs de l’IA résolvent moins bien les problèmes finaux et abandonnent plus souvent que les participants sans IA.

La deuxième expérience, conçue pour corriger certaines limites méthodologiques de la première, confirme la baisse de performance autonome après retrait de l’IA.

La troisième expérience montre le même phénomène dans un domaine différent, la compréhension de lecture, ce qui renforce l’idée qu’il ne s’agit pas d’un effet limité au calcul, mais d’un mécanisme plus général touchant des tâches où l’effort cognitif et l’endurance mentale comptent.

Un point particulièrement intéressant est que le coût principal semble lié à la manière d’utiliser l’IA. Dans la deuxième expérience, les participants ont indiqué après coup s’ils s’étaient surtout servis de l’outil pour obtenir des réponses toutes faites, pour recevoir des indices ou des clarifications, ou s’ils ne l’avaient pas vraiment utilisé. Ceux qui avaient surtout demandé des réponses directes sont ceux qui, ensuite, ont le plus baissé en performance et le plus augmenté leur tendance à abandonner. À l’inverse, l’usage orienté vers l’aide à la compréhension paraît moins nuisible. Les auteurs en déduisent que le problème n’est pas seulement la présence de l’IA, mais le fait qu’elle remplace l’effort personnel au lieu de le soutenir. Autrement dit, une IA qui “fait à la place de” l’utilisateur n’a pas le même effet qu’une IA qui “aide à faire”.

Sur le plan explicatif, l’article avance deux mécanismes. D’abord, l’IA habituera l’utilisateur à l’immédiateté: quand une machine résout une difficulté en quelques secondes, le travail sans assistance paraît soudainement plus long, plus pénible et moins attrayant qu’il ne l’était auparavant. Ensuite, l’IA priverait l’utilisateur de l’expérience formatrice de la difficulté. Or, selon les auteurs, c’est en traversant un problème sans solution instantanée que l’on construit non seulement des connaissances, mais aussi une estimation plus juste de ce qu’on est capable de faire soi-même. Si cette expérience disparaît, la confiance en ses propres moyens et la capacité de persister risquent de se dégrader. L’originalité de l’article est donc de déplacer le débat: le danger n’est pas seulement une erreur de l’IA ou une dépendance technique visible, mais une érosion progressive de capacités humaines ordinaires, parfois en quelques minutes seulement.

Pour des juristes, y compris en Suisse, l’intérêt du texte dépasse la psychologie expérimentale. Il met en lumière un risque de dépendance fonctionnelle qui ne se réduit pas à la qualité des réponses produites par l’IA. Même une IA exacte et utile peut avoir un effet secondaire négatif sur l’autonomie professionnelle ou intellectuelle de son utilisateur.

Cela nourrit plusieurs questions de gouvernance: comment concevoir des outils qui assistent sans désapprendre, comment organiser leur usage dans la formation, comment distinguer un soutien pédagogique d’une substitution cognitive, et comment intégrer dans l’évaluation des systèmes non seulement le gain immédiat de productivité, mais aussi leurs effets dans le temps sur les compétences humaines. Les auteurs plaident ainsi pour des systèmes d’IA pensés comme des collaborateurs de long terme, capables d’aider sans toujours livrer la solution complète, et orientés vers le développement de la compétence humaine autant que vers l’exécution de la tâche.

La portée de l’article doit toutefois être appréciée avec mesure. Il s’agit d’une prépublication, les tâches testées sont relativement brèves, menées en ligne, sur des problèmes scolaires ou proches du test standardisé, et l’étude n’établit pas encore ce qui se passe sur plusieurs mois ou dans des activités professionnelles complexes. Les auteurs reconnaissent d’ailleurs eux-mêmes que la grande question reste celle de l’accumulation dans le temps. Mais leur conclusion est nette: même un usage très court d’une IA conçue pour donner des réponses immédiates peut réduire la persévérance et la performance indépendante lorsque l’outil n’est plus là. Leur message central n’est donc pas “l’IA est mauvaise”, mais plutôt “une IA utile à court terme peut devenir contre-productive si elle n’est pas conçue pour préserver l’autonomie de l’utilisateur”.

Me Philippe Ehrenström, avocat, LLM, CAS en Droit et Intelligence artificielle, CAS en Protection des données – Entreprise et administration