L’article de Stephen Pearson, Whodunit? Nobody Knows: A Critical Analysis of AI Liability Schemes, qui vient d’être publié dans l’Arizona State Law Journal (https://arizonastatelawjournal.org/2026/05/01/whodunit-nobody-knows-a-criticalanalysis-of-ai-liability-schemes/) part d’un problème qui est devenu très concret: lorsqu’un système d’IA génère un contenu illicite, faux, diffamatoire, discriminatoire ou pénalement problématique, à qui imputer la responsabilité ? L’utilisateur final, qui a déclenché ou publié le résultat ? Le développeur, qui a conçu et commercialisé le modèle ? Ou l’IA elle-même, qui a matériellement produit l’acte litigieux ?

L’auteur illustre cette difficulté avec l’affaire de l’avocat new-yorkais Steven Schwartz, qui avait utilisé ChatGPT pour sa recherche juridique et déposé des références jurisprudentielles inexistantes. Le cas est simple dans son issue disciplinaire, mais il révèle une question plus large : un utilisateur ordinaire peut-il être traité comme responsable d’un comportement technique qu’il ne comprend pas, surtout lorsque même les concepteurs du système ne maîtrisent pas entièrement son fonctionnement ?

L’article expose d’abord, en termes accessibles, pourquoi les modèles actuels d’IA ne sont pas de simples outils passifs. Les grands modèles de langage, comme ChatGPT, ne « recherchent » pas l’information au sens classique. Ils prédisent statistiquement la suite la plus probable d’un texte à partir d’un entraînement massif sur des données textuelles. Cette architecture repose sur des réseaux neuronaux, des couches de transformation, des mécanismes d’attention et des paramètres internes dont le comportement exact reste largement opaque. L’auteur insiste sur le caractère de « boîte noire » de ces systèmes : ils produisent des résultats utiles, souvent convaincants, parfois remarquablement humains, mais ils peuvent aussi halluciner, c’est-à-dire présenter comme exacts des éléments entièrement fabriqués. Les modèles de génération d’images, fondés notamment sur des méthodes de diffusion, posent des difficultés similaires : ils peuvent générer des contenus portant atteinte à la personnalité, à la réputation, à la propriété intellectuelle ou à l’intégrité sexuelle des personnes représentées.

Sur le plan juridique, Pearson estime que le droit américain ne dispose pas encore d’un cadre uniforme et satisfaisant. Les réponses existantes sont fragmentaires. Certaines initiatives législatives visent des usages précis, notamment les deepfakes pornographiques non consentis. Des contentieux émergent aussi, par exemple contre des sites permettant de générer des images sexuelles à partir de photographies de femmes ou de mineures. Mais ces réponses restent sectorielles. Elles ne résolvent pas la question générale de l’allocation de responsabilité lorsqu’un système d’IA cause un dommage civil ou facilite une infraction.

L’auteur relève ainsi que l’on se trouve dans une zone encore mal balisée, tiraillée entre deux impératifs : sanctionner les usages malveillants ou irresponsables, sans étouffer l’adoption d’une technologie appelée à devenir centrale.

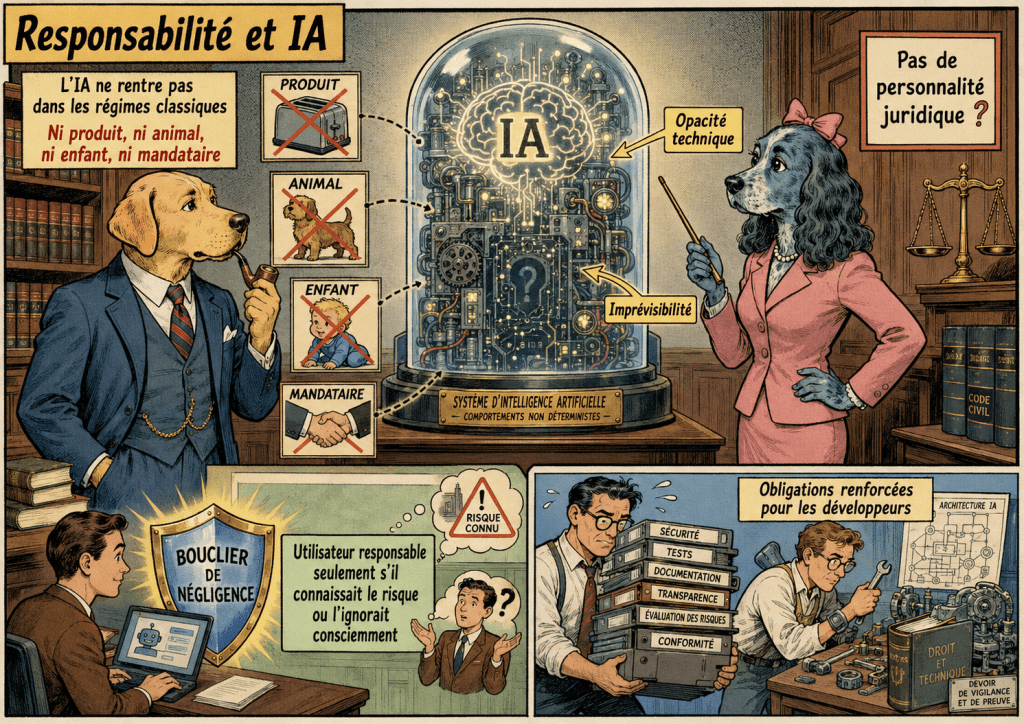

L’auteur examine ensuite plusieurs analogies juridiques possibles.

La première est celle de la responsabilité du fait des produits. Elle a l’avantage de viser le fabricant ou le fournisseur, et elle pourrait inciter les développeurs à mieux entraîner leurs modèles, à filtrer les comportements dangereux et à avertir les utilisateurs. Mais Pearson juge cette analogie insuffisante. Un système d’IA n’est pas un produit ordinaire comme une machine défectueuse. Il évolue, répond à des instructions variables, combine des composants multiples et prend des décisions difficiles à reconstituer. Identifier un défaut précis, une causalité technique ou une faute de conception peut devenir extrêmement difficile. À l’inverse, une responsabilité stricte du développeur risquerait de freiner fortement l’innovation.

La seconde analogie est celle de la responsabilité du propriétaire d’un animal. Certains auteurs proposent de traiter l’IA comme un animal domestique, avec une logique de « première morsure » : le propriétaire ne devient strictement responsable qu’après avoir eu connaissance d’une dangerosité antérieure. Pearson rejette cette comparaison. Un développeur ne contrôle pas l’usage quotidien d’un modèle comme un propriétaire contrôle son chien ; l’utilisateur final, de son côté, ne comprend pas nécessairement les signaux de danger comme il reconnaîtrait l’agressivité d’un animal. Assimiler l’IA à un animal sauvage serait encore plus excessif, car cela reviendrait à présumer un danger intrinsèque et évident, alors que les outils d’IA grand public sont précisément commercialisés comme simples, utiles et sûrs.

La troisième analogie est celle de la responsabilité parentale. Elle échoue également, selon l’auteur, car elle suppose un développement progressif vers l’autonomie et, à terme, vers une personnalité juridique propre. Or l’IA n’est pas un enfant. Les développeurs n’élèvent pas un sujet humain ; ils entraînent un système technique. Les utilisateurs ne vivent pas avec l’IA, ne l’éduquent pas et ne disposent pas sur elle d’un pouvoir comparable à celui des parents. L’application de ce modèle conduirait soit à une fiction trop forte, soit à une forme de personnalité juridique de l’IA que l’auteur juge prématurée et dangereuse [ce qui est un point de vue qui se discute !!]

La quatrième analogie est celle du rapport principal-agent. Elle paraît séduisante, car l’utilisateur donne une instruction et l’IA exécute une tâche. Mais Pearson considère que cette qualification ne tient pas. Une relation d’agence suppose un assentiment mutuel, un contrôle du principal et une action de l’agent pour le compte du principal. Or l’IA ne manifeste pas juridiquement un consentement, et l’utilisateur ne contrôle pas réellement son fonctionnement interne. En pratique, il ne peut ni former le modèle, ni corriger ses paramètres, ni prévoir toutes ses erreurs. Traiter l’utilisateur comme un responsable des actes de son agent reviendrait donc à lui imputer une maîtrise qu’il n’a pas.

L’auteur écarte aussi, pour l’essentiel, l’idée d’accorder une personnalité juridique à l’IA. Selon lui, cette piste n’est pas sérieuse à ce stade. Une personnalité juridique suppose une capacité à répondre juridiquement de ses actes, à posséder un patrimoine, à ester en justice ou à subir des sanctions. Les systèmes actuels ne disposent d’aucune de ces caractéristiques de manière autonome. Surtout, reconnaître une telle personnalité risquerait de déresponsabiliser les entreprises qui conçoivent, déploient et monétisent ces outils.

La proposition centrale de l’article est donc la suivante : instaurer, au profit des utilisateurs finaux, un « bouclier de négligence » réfragable. Concrètement, lorsqu’un modèle d’IA commet un acte dommageable sous la supervision d’un utilisateur, celui-ci ne devrait pas être tenu responsable s’il n’a fait preuve que de simple négligence. Pour engager sa responsabilité, il faudrait établir au minimum une imprudence consciente, c’est-à-dire que l’utilisateur a effectivement envisagé le risque de résultat illicite et l’a ignoré. En matière civile, cela signifie que la simple violation du standard de diligence raisonnable ne suffirait pas, du moins pour l’utilisateur ordinaire confronté à un système opaque et nouveau.

Ce bouclier ne serait toutefois pas absolu. Pearson prévoit trois cas dans lesquels il pourrait être renversé. D’abord, si l’utilisateur dispose de compétences techniques ou de connaissances particulières en IA, il ne peut pas prétendre à la même protection qu’un profane. Ensuite, si l’utilisateur a déjà été confronté à un comportement similaire du même modèle, par exemple une hallucination causant un dommage ou une notification antérieure d’usage problématique, il ne peut plus invoquer son ignorance. Enfin, le bouclier ne s’appliquerait pas à celui qui utilise délibérément un système manifestement conçu pour produire des résultats dangereux, comme certains générateurs de contenus pornographiques non consentis. L’idée est donc de protéger l’utilisateur de bonne foi et non le professionnel averti, le récidiviste ou l’auteur d’un usage manifestement abusif.

L’effet pratique de cette proposition serait de déplacer une partie du risque de la simple négligence vers les développeurs et les entreprises qui mettent ces modèles sur le marché. L’auteur assume ce déplacement. Selon lui, ces entreprises sont mieux placées pour connaître les défaillances récurrentes, corriger les garde-fous, tester les usages à risque, avertir les utilisateurs et imposer des formations minimales lors de l’inscription. Cette allocation de responsabilité les inciterait à plus de transparence et à une conception plus prudente, sans les rendre responsables des usages intentionnellement malveillants. Pearson compare ici les développeurs d’IA à des fabricants d’outils potentiellement dangereux : ils ne doivent pas répondre de toute manipulation criminelle, mais ils peuvent légitimement supporter une obligation accrue de prévention lorsque le dommage résulte d’un usage naïf, prévisible et insuffisamment encadré.

Pour des avocats suisses, l’intérêt de l’article tient moins à la solution technique proposée en droit américain qu’à la méthode. Pearson montre que les catégories traditionnelles — produit, animal, enfant, mandataire, personne juridique — sont utiles comme points de comparaison, mais inadéquates comme réponses complètes. Son raisonnement invite à distinguer soigneusement l’utilisateur profane, l’utilisateur averti, le développeur, le fournisseur et le tiers lésé. Il invite aussi à ne pas confondre faute, maîtrise technique et causalité apparente. En définitive, l’article défend une solution d’équilibre : ne pas immuniser l’usage de l’IA, ne pas abandonner les victimes, mais éviter d’imposer à l’utilisateur ordinaire une responsabilité fondée sur une compréhension technique qu’il ne possède pas. La thèse finale est claire : l’IA n’est ni une personne, ni un animal, ni un enfant, ni un agent au sens classique ; elle appelle donc un régime propre, centré sur la connaissance effective du risque, la prévisibilité concrète du dommage et la capacité réelle de prévention.

Me Philippe Ehrenström, avocat, LLM, CAS en Droit et Intelligence artificielle, CAS en Protection des données – Entreprise et administration